Theo dự báo của VSEC, các vụ tấn công mạng bằng AI, trong đó có lừa đảo Deepfake để giả mạo khuôn mặt, giọng nói sẽ gia tăng trong năm 2024.

Công ty An ninh mạng Việt Nam (VSEC) vừa công bố báo cáo tổng hợp về tình hình an ninh mạng năm 2023 và xu hướng năm 2024.

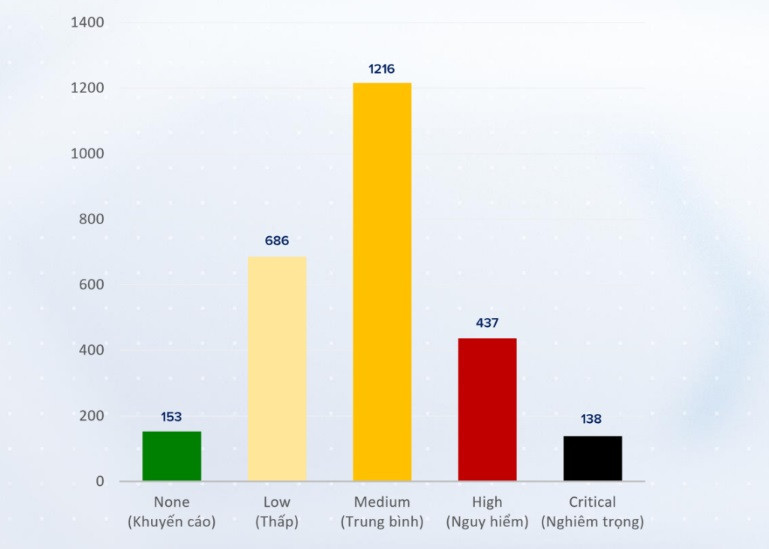

Trong năm 2023, đơn vị này đã ghi nhận 148.615 sự cố và 2.630 lỗ hổng bảo mật. Về tổng quan, lượng lỗ hổng bảo mật được phát hiện tại Việt Nam đang có chiều hướng gia tăng. Nếu so với chỉ một năm trước đó, số lượng lỗ hổng mà VSEC phát hiện trong năm 2023 có sự nhảy vọt, lên tới 21%.

Theo quan sát của VSEC, trong năm 2023, tỷ lệ sự cố về truy cập trái phép, chiếm quyền điều khiển, chiếm tỷ trọng lớn nhất tại Việt Nam. Các sự cố an toàn thông tin dạng này thường xảy ra ở nhóm doanh nghiệp ngân hàng, tài chính và bảo hiểm.

Website dường như là hệ thống CNTT yếu nhất, bởi các vụ tấn công vào đây hiện chiếm tỷ trọng cao, cả ở khối hành chính công và doanh nghiệp. Cụ thể, số sự cố từ website của doanh nghiệp hiện chiếm tỷ lệ 62%, trong khi ở khối hành chính công là khoảng 59%.

>> TP.HCM ra mắt phần mềm lắng nghe mạng xã hội

Theo ông Hà Minh Vũ, Trưởng nhóm tư vấn công nghệ của VSEC, các loại hình tấn công mạng phổ biến nhất năm 2023 được đơn vị này ghi nhận là các vụ lừa đảo online, cài cắm mã độc tống tiền, ăn cắp danh tính, các vụ xâm phạm vào email của doanh nghiệp và tấn công DDoS.

Đưa ra dự báo, ông Hà Minh Vũ cho rằng, môi trường an toàn thông tin năm 2024 được đánh giá là khó khăn và sẽ có nhiều biến động; Nguyên nhân do nhận thức về các lỗ hổng an ninh mạng còn thiếu hụt ở nhiều tổ chức, doanh nghiệp tại Việt Nam.

Các loại hình tấn công mạng sẽ trở thành xu hướng năm 2024 là tấn công bằng mã độc tốc tống tiền (ransomeware) và các vụ tấn công liên quan đến trí tuệ nhân tạo .

Các hệ thống nguồn mở, hệ thống IoT, hệ thống vận hành (OT), môi trường điện toán đám mây và email doanh nghiệp sẽ là những mục tiêu bị nhắm đến phổ biến bởi tin tặc.

Trong năm 2023, VSEC nhận được nhiều báo cáo phản ánh từ người dùng, doanh nghiệp và các tổ chức về các vụ tấn công mã hóa tập tin để đòi tiền chuộc do mã độc thực hiện.

Đa số các cuộc tấn công bằng ransomware đều dẫn đến hệ quả là việc mất dữ liệu, từ đó để lại hậu quả nghiêm trọng. Do vậy, ông Vũ đặc biệt lưu ý đến vấn đề này, bởi hình thức tấn công bằng mã độc tống tiền sẽ ngày càng tinh vi, phức tạp hơn trong năm 2024.

Với sự nổi lên của trí tuệ nhân tạo thời gian gần đây, Trưởng nhóm tư vấn công nghệ VSEC cho rằng, tội phạm mạng có thể tấn công vào các nguồn dữ liệu để làm nhiễm bẩn việc đào tạo học máy, dẫn tới kết quả đầu ra của AI bị sai lệch và không chính xác.

Bên cạnh việc gọi điện giả danh nhân viên ngân hàng, công an như trước kia, các hacker đang ngày một tinh vi hơn khi sử dụng Deepfake để giả dạng người khác, hoặc ghép khuôn mặt kẻ lừa đảo vào hình ảnh bộ quân phục.

Tại Việt Nam, các vụ tấn công bằng AI để tạo ra nội dung giả mạo như video, giọng nói, hình ảnh, tin nhắn nhằm lừa đảo người dùng đang tăng lên. Nhiều người dân đã bị tấn công bằng hình thức này và sau đó trở thành nạn nhân, bị chiếm đoạt tiền, quyền sử dụng tài khoản ngân hàng và thông tin cá nhân bởi những kẻ lừa đảo.

Theo chuyên gia bảo mật Hà Minh Vũ, để tự bảo vệ mình trên môi trường mạng, người dùng Internet cần tạo cho mình thói quen “zero trust”, tức là không tin tai cả. Người dùng mạng cũng nên thường xuyên sử dụng việc xác thực đa yếu tố, đồng thời tự bảo vệ dữ liệu cá nhân bằng việc sao lưu thông tin ở nhiều môi trường.

>> Chuyên gia gợi ý cách ngăn ngừa bị giả mạo hình ảnh bằng deepfake

Công an tìm nạn nhân của 'bác sĩ’ Nguyễn Quán Hùng

Đất nền 'sốt ảo' sau thông tin sáp nhập, Phó Chủ tịch tỉnh yêu cầu công an vào cuộc