Nạn deepfake bùng nổ ở Nhật Bản, số vụ lừa đảo tăng gấp 28 lần so với năm ngoái

Những kẻ lừa đảo đã sử dụng AI để tạo ra giọng nói, âm thanh trong video nghe như người thật.

Theo dữ liệu từ khu vực tư nhân, việc sử dụng deepfake để lừa đảo đã tăng đột biến tại Nhật Bản , cho thấy rào cản ngôn ngữ không còn là biện pháp bảo vệ chống lại những kẻ lừa đảo toàn cầu nữa.

Thống kê của Sumsub, một nhà cung cấp dịch vụ xác minh danh tính của Anh, cho thấy số vụ deepfake ở Nhật Bản đã tăng gấp 28 lần vào năm ngoái. Đây là mức tăng lớn thứ 5 trong số 224 nền kinh tế được theo dõi.

Trong quý đầu năm nay, những vụ lừa đảo ở quốc gia này tăng gấp đôi so với cùng kỳ năm trước. Sumsub vẫn chưa công bố số vụ việc thực tế.

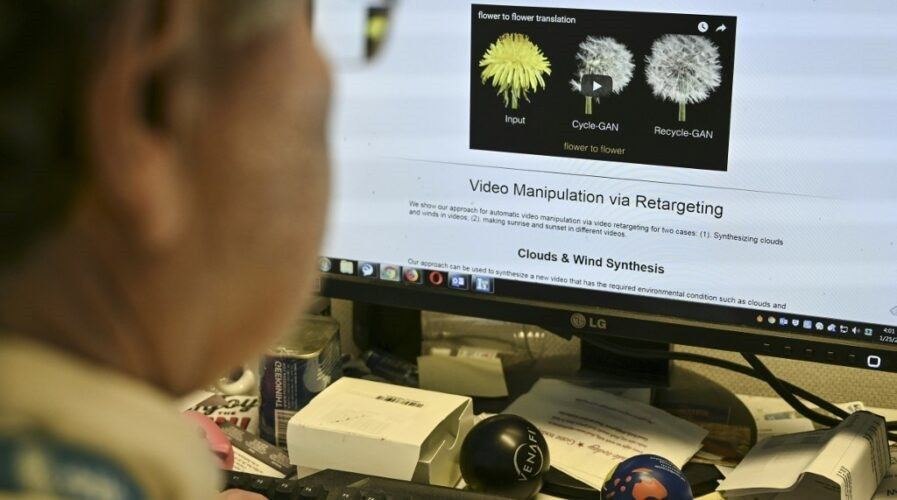

Được biết deepfake là một kỹ thuật kết hợp giữa các thuật toán học sâu và học máy với mục đích tạo ra những video, hình ảnh hoặc âm thanh giả mạo một cách rất chân thực.

Trong một video giả mạo được lan truyền trên mạng xã hội Nhật Bản vào tháng 11 năm ngoái, cảnh quay của một phân đoạn trong chương trình tin tức truyền hình đã được chỉnh sửa lại nhằm lừa người xem đăng ký vào một trang web đầu tư.

Các vụ lừa đảo tài chính thường do các nhóm bao gồm nhiều thành viên ở những quốc gia khác nhau thực hiện. Cho đến gần đây, Nhật Bản vẫn có tỷ lệ lừa đảo thành công thấp so với những nơi nói tiếng Anh, một phần là vì tiếng Nhật được coi là một trong những ngôn ngữ khó học nhất trên thế giới, các chuyên gia bảo mật cho biết.

Nhưng AI giờ đây có thể tạo ra các tin nhắn giọng nói và video giả mạo bằng tiếng Nhật với mức độ lưu loát như người bản xứ. Điều này có nghĩa là các tổ chức tội phạm muốn nhắm mục tiêu vào Nhật Bản không còn phải đối mặt với rào cản ngôn ngữ nữa.

Công nghệ AI cũng thúc đẩy sự gia tăng tương tự trong các nỗ lực lừa đảo sử dụng phương tiện truyền thông dạng văn bản. Công ty an ninh mạng Proofpoint của Mỹ tiết lộ, năm ngoái, Nhật Bản chứng kiến sự gia tăng lớn nhất về tỷ lệ các doanh nghiệp báo cáo nhận được email lừa đảo.

Trong khi đó, công ty phân tích Elliptic của Anh phát hiện các công cụ được rao bán trên ứng dụng nhắn tin Telegram có thể tạo ra tin nhắn giọng nói giả bằng nhiều ngôn ngữ khác nhau. Tuy nhiên, mức độ chính xác của chúng hiện chưa rõ ràng.

Dù vậy, những kẻ lừa đảo deepfake vẫn ghi được nhiều “cú đánh” lớn. Vào tháng 2, một nhân viên tại một công ty kỹ thuật đa quốc gia có trụ sở tại Anh đã bị lừa chuyển 25,6 triệu USD sau khi tham gia vào một cuộc gọi video giả mạo.

Một quan chức cảnh sát cấp cao của Nhật Bản bình luận: "Không rõ mức độ mà deepfake đang được sử dụng trong các vụ lừa đảo ở Nhật Bản. Tuy nhiên, có khả năng những phương pháp này sẽ trở nên tinh vi hơn".

Năm ngoái, Viện Tin học Quốc gia tại Tokyo đã phát hành một chương trình có thể nhận dạng hình ảnh khuôn mặt có phải là deepfake hay không.

Các nhóm tài chính đang áp dụng chương trình này để ngăn chặn việc giả mạo danh tính thông qua nhận dạng khuôn mặt. Cuối năm nay, viện sẽ triển khai một phiên bản có thể nhận dạng âm thanh deepfake.

"Những cuộc gọi lừa đảo sử dụng âm thanh bắt chước giọng nói của người thân cũng là một mối lo ngại. Trong tương lai, chúng tôi sẽ tìm cách cho phép thiết bị của người tiêu dùng phát hiện những cuộc gọi như vậy", Junichi Yamagishi, một giáo sư tại viện chia sẻ.

Theo Nikkei Asia